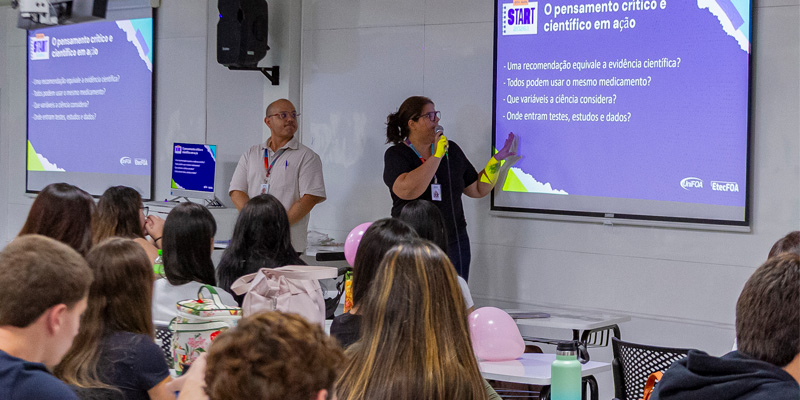

A programação do Start MEDVR do Centro Universitário de Volta Redonda (UniFOA), iniciativa de acolhimento aos ingressantes do curso de Medicina, trouxe para o centro do debate um dos temas mais atuais da formação médica: “A pesquisa e o médico na era da IA: limites, possibilidades e responsabilidades”. A proposta da atividade foi inserir, logo nos primeiros dias de aula, uma reflexão crítica sobre o uso da Inteligência Artificial na prática clínica e na produção científica.

A discussão partiu de uma constatação concreta: a IA já integra processos diagnósticos, protocolos terapêuticos, gestão de dados e pesquisas acadêmicas. No entanto, conforme destacaram os docentes responsáveis pela atividade, tecnologia sem pensamento crítico pode comprometer o rigor científico e a responsabilidade profissional.

O professor Rafael Moreira enfatizou que a Inteligência Artificial deve ser compreendida como ferramenta de apoio à pesquisa, mas nunca como substituta da investigação aprofundada.

“A IA é uma ferramenta incrível para ajudar os estudantes na área da pesquisa, porém ela não os prepara para os detalhes mais minuciosos de uma pesquisa científica, fornecendo informações que são muito superficiais para um contexto acadêmico. É necessário utilizar fontes de pesquisa de artigos científicos confiáveis, pois elas trazem o rigor científico e a confiabilidade necessários para potencializar a pesquisa”, afirmou.

Para o docente, a rapidez com que as plataformas digitais entregam respostas exige cautela redobrada. Ele reforçou que velocidade não é sinônimo de precisão científica.

“Os estudantes precisam olhar para a IA como uma auxiliadora nas pesquisas rápidas. Entretanto, não podemos esquecer que respostas rápidas nem sempre são confiáveis. Acreditar 100% nas informações da IA é construir um telhado de vidro facilmente quebrável. Para isso, eles devem usar esses artifícios tecnológicos sem esquecer de exercer o pensamento crítico para diminuir erros”, destacou.

A professora Aline Gomes ampliou a reflexão ao abordar os limites éticos e humanísticos do uso da tecnologia na Medicina. Segundo ela, a responsabilidade pelas decisões clínicas permanece, integralmente, sob responsabilidade do profissional.

“A IA é uma ferramenta de apoio, e não um substituto do julgamento crítico do profissional da área. Mesmo quando a decisão é apoiada por ferramentas tecnológicas, a responsabilidade ética e legal permanece sendo do ser humano, nesse caso, do médico”, pontuou.

A docente também alertou para os riscos relacionados à privacidade de dados e à confiabilidade das informações disponíveis na internet, que podem ser incorporadas de forma indiscriminada por sistemas automatizados.

“É fundamental compreender os riscos relacionados à privacidade de dados e ao uso de bases informacionais disponíveis na web, que muitas vezes a IA não reconhece se são de origem confiável e acaba por utilizá-las em suas respostas. O futuro médico precisa desenvolver senso crítico para questionar resultados automatizados, avaliar evidências e reconhecer limites técnicos”, explicou.

Para Aline, a discussão ultrapassa o campo técnico e alcança a essência da prática médica.

“Existe um limite humanístico, pois a medicina envolve escuta, vínculo e responsabilidade ética com o sofrimento humano. A IA pode ampliar a capacidade técnica, mas não substitui o atendimento humanizado que os pacientes necessitam quando buscam assistência médica”, concluiu.

Ao inserir o debate sobre Inteligência Artificial já no início da graduação, o curso de Medicina demonstra o compromisso com uma formação alinhada às transformações tecnológicas, sem abrir mão do rigor científico e dos princípios éticos que sustentam a prática médica. Mais do que preparar estudantes para utilizar ferramentas digitais, a proposta é formar profissionais capazes de questioná-las, analisá-las criticamente e empregá-las com responsabilidade, uma competência indispensável na Medicina contemporânea.

Copyright © – UniFOA | Todos os direitos reservados à Fundação Oswaldo Aranha